Last Updated on agosto 26, 2024 12:48 pm by Laszlo Szabo / NowadAIs | Published on agosto 26, 2024 by Laszlo Szabo / NowadAIs

Jamba 1.5: La IA híbrida de AI21 es 2,5 veces más rápida que la de sus principales competidores – Notas clave

- Jamba 1.5 combina las arquitecturas Transformer y Mamba, ofreciendo un mayor rendimiento y eficiencia.

- El modelo maneja escenarios de contexto largo con una ventana de contexto de 256.000 tokens, manteniendo un rendimiento máximo.

- Las funciones multilingües de Jamba 1.5 lo hacen eficaz en varios idiomas, entre ellos el español, el francés y el alemán.

- El modelo introduce la técnica de cuantificación ExpertsInt8, que permite un despliegue a gran escala con un hardware mínimo.

Introducción

Presentamos Jamba 1.5, una maravilla híbrida de IA que combina a la perfección los puntos fuertes de las arquitecturas Transformer y Mamba, ofreciendo un rendimiento, una eficiencia y una versatilidad sin precedentes. Desarrollada por las mentes visionarias de AI21, esta tecnología de vanguardia está cambiando lo que es posible en el ámbito del procesamiento del lenguaje natural.

La ventaja de Jamba 1.5: Una potencia híbrida

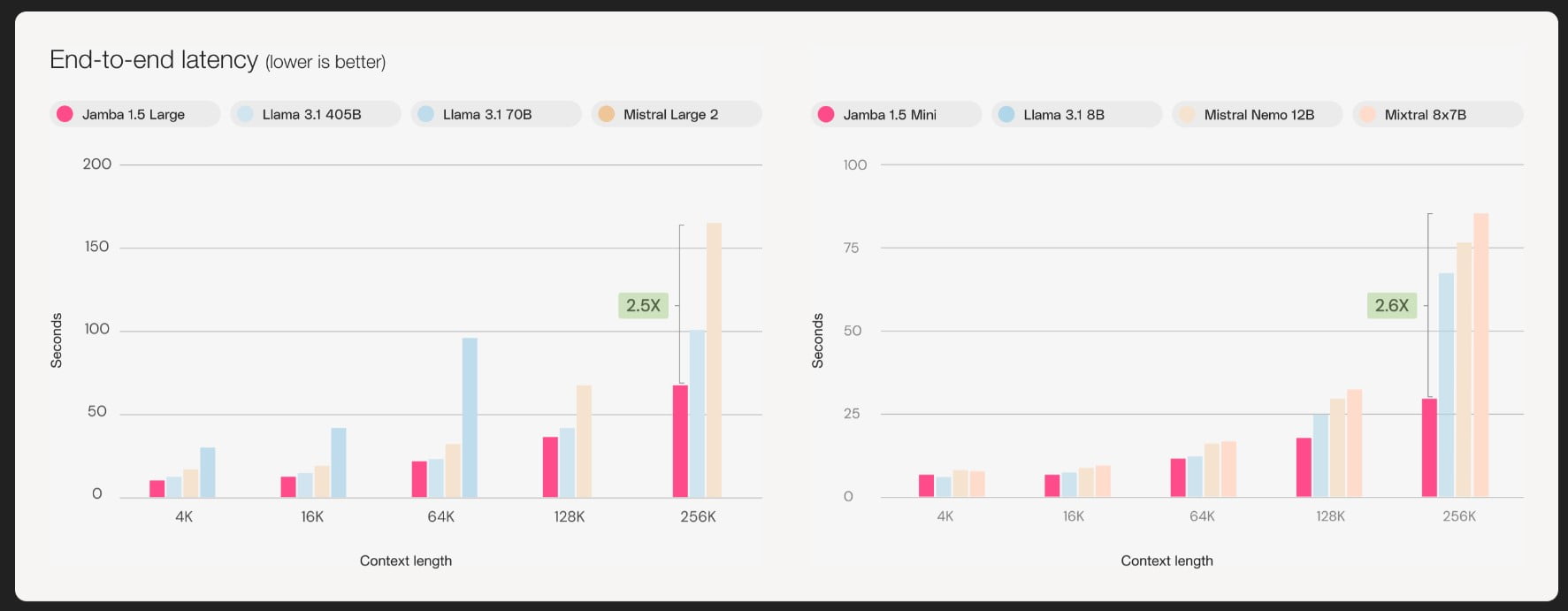

En el núcleo de Jamba 1.5 se encuentra un novedoso enfoque que armoniza lo mejor de ambos mundos: la robusta arquitectura Transformer y el innovador marco Mamba. Esta fusión sinérgica da como resultado un modelo híbrido que no sólo sobresale en la gestión de escenarios de contexto largo, sino que también presume de una velocidad y eficiencia notables, superando a sus homólogos en la asombrosa cifra de 2,5 veces.

Capacidad de gestión de contextos sin precedentes

Una de las características más destacadas de Jamba 1.5 es su capacidad para navegar y procesar sin problemas amplia información contextual. Con una ventana de contexto sin precedentes de 256.000 tokens, esta maravilla de la IA permite a los usuarios interactuar y comprender narraciones intrincadas, conjuntos de datos complejos y documentos voluminosos con una precisión y claridad inigualables.

Optimizado para la velocidad y la eficiencia

Jamba 1.5 no es sólo una potencia en términos de rendimiento, sino también un pionero en el ámbito de la velocidad y la eficiencia. Gracias a su arquitectura de vanguardia, este modelo ofrece tiempos de inferencia rapidísimos, lo que lo convierte en la opción ideal para aplicaciones sensibles al tiempo e interacciones en tiempo real.

Una caja de herramientas versátil para diversas aplicaciones

Tanto si busca mejorar la experiencia de los servicios de atención al cliente como agilizar los procesos empresariales o abrir nuevas fronteras en la investigación y el desarrollo, Jamba 1.5 le ofrece un conjunto de herramientas versátiles adaptadas a sus necesidades específicas. Con capacidades que van desde la llamada a funciones y la generación de resultados estructurados hasta la generación fundamentada y la comprensión del lenguaje, esta IA le permite abordar una amplia gama de retos con una precisión y adaptabilidad sin precedentes.

Proeza multilingüe: Superar las barreras lingüísticas

Jamba 1.5 no sólo es un virtuoso lingüístico en inglés, sino que también domina multitud de idiomas, como el español, el francés, el portugués, el italiano, el holandés, el alemán, el árabe y el hebreo. Esta destreza multilingüe abre nuevas vías para la comunicación intercultural, permitiendo a empresas y organizaciones conectar con públicos diversos a escala mundial.

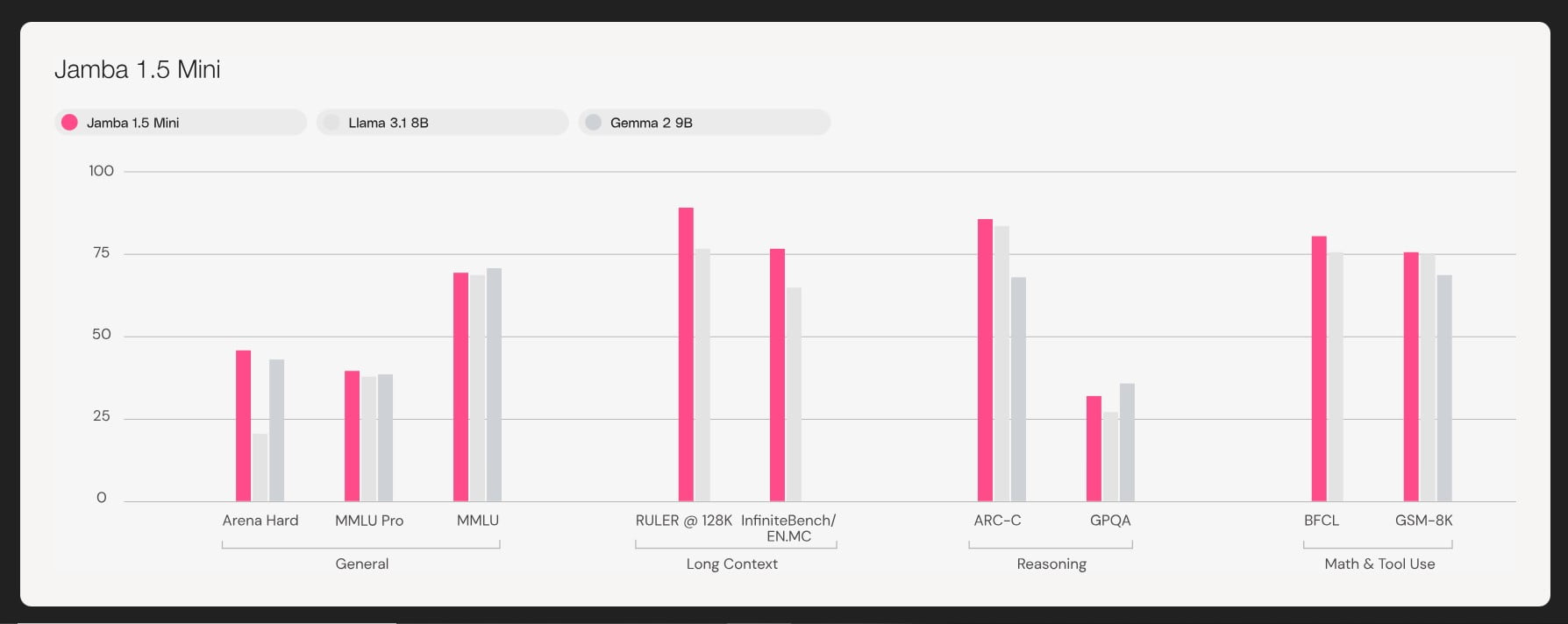

Excelencia en la evaluación comparativa

Cuando se trata de pruebas de rendimiento, Jamba 1.5 pone el listón muy alto, superando constantemente a sus compañeros a través de una amplia gama de pruebas estándar de la industria. Desde sobresalir en tareas exigentes como Arena Hard y Wild Bench hasta ofrecer resultados de primera categoría en pruebas de comprensión del lenguaje como MMLU y GPQA, este modelo de IA demuestra su valía una y otra vez.

Longitud de contexto eficaz: Mantener el máximo rendimiento

Uno de los aspectos más destacables de Jamba 1.5 es su capacidad para mantener un rendimiento máximo durante toda su extensa ventana de contexto. A diferencia de muchos otros modelos, cuya eficacia disminuye a medida que aumenta la longitud de los contextos, Jamba 1.5 ofrece siempre resultados fiables y precisos, incluso con las entradas más complejas y largas.

Innovación en cuantificación

Para mejorar aún más sus capacidades y accesibilidad, AI21 ha introducido una técnica de cuantificación denominada ExpertsInt8. Este innovador enfoque permite implantar Jamba 1.5 Large, la variante de mayor tamaño de la familia de modelos, en una sola máquina con sólo ocho GPU de 80 GB, sin comprometer la calidad ni el rendimiento. Este logro no sólo amplía el alcance del modelo, sino que también allana el camino para implantaciones más eficientes y rentables.

Integración perfecta: Multitud de opciones de implantación

Tanto si busca una solución basada en la nube como si prefiere una implantación local, Jamba 1.5 ofrece una gama de opciones que se adaptan a sus necesidades específicas. Desde la plataforma SaaS de calidad de producción de AI21 hasta asociaciones estratégicas con líderes del sector e implantaciones VPC y locales personalizadas, esta maravilla de la IA garantiza una integración perfecta en su infraestructura actual.

Capacitar a las empresas: Soluciones a medida

Para las empresas con requisitos únicos y a medida, AI21 va más allá, ofreciendo gestión práctica, formación previa continua y capacidades de ajuste. Este enfoque personalizado garantiza que Jamba 1.5 se adapte a las necesidades específicas de su organización, abriendo nuevos horizontes de productividad e innovación.

Dar rienda suelta a la creatividad: Herramientas para desarrolladores

Jamba 1.5 no es sólo una potencia para las empresas; también es un tesoro para desarrolladores y creadores. Con funciones integradas como la llamada a funciones, la salida en modo JSON, los objetos de documento y el modo de cita, este modelo de IA permite a los desarrolladores dar rienda suelta a su creatividad y crear aplicaciones.

IA ética y responsable: un compromiso con la excelencia

En el corazón del desarrollo de Jamba 1.5 se encuentra un firme compromiso con las prácticas éticas y responsables de la IA. AI21 ha dado grandes pasos para garantizar que este modelo se adhiere a los más altos estándares de transparencia, privacidad y seguridad, fomentando la confianza entre los usuarios y las partes interesadas por igual.

El futuro de la IA: la adopción de Jamba 1.5

A medida que el mundo continúa adoptando el potencial transformador de la inteligencia artificial, Jamba 1.5 se erige como un faro de innovación y progreso. Con sus capacidades inigualables, su eficiencia sin parangón y su compromiso inquebrantable con la excelencia, este asombroso modelo de IA está preparado para dar forma al futuro del procesamiento del lenguaje natural y más allá. Aproveche la potencia de Jamba 1.5 y abra un mundo de posibilidades

Descripciones

- Modelo de IA híbrida: Combinación de diferentes arquitecturas de IA para aprovechar los puntos fuertes de cada una. Jamba 1.5 integra las arquitecturas Transformer y Mamba para mejorar la capacidad de procesamiento y la eficacia.

- Ventana contextual: La cantidad de texto que la IA puede procesar a la vez. Jamba 1.5 tiene una ventana de contexto de 256.000 tokens, lo que significa que puede procesar textos muy largos sin perder precisión.

- Cuantización (ExpertsInt8): Una técnica para reducir el tamaño y la complejidad de un modelo de inteligencia artificial sin sacrificar el rendimiento. Esto permite que Jamba 1.5 Large funcione en menos GPU, lo que lo hace más accesible.

- Llamada a funciones: Una característica que permite a la IA ejecutar funciones o tareas específicas basadas en la entrada del usuario. Jamba 1.5 incluye esta función para obtener resultados más interactivos y dinámicos.

- Generación basada en texto: La capacidad de la IA para generar texto basado en datos o fuentes específicos del mundo real, lo que garantiza una información más precisa y fiable.

- Despliegue local: Una configuración en la que los modelos de IA se ejecutan en los servidores físicos dentro de una organización, ofreciendo un mayor control sobre los datos y las operaciones. Jamba 1.5 admite esta opción junto con las soluciones basadas en la nube.

Preguntas más frecuentes

- ¿Qué es Jamba 1.5 y en qué se diferencia de los modelos anteriores?

Jamba 1.5 es un modelo híbrido de IA que combina las arquitecturas Transformer y Mamba. Destaca en el procesamiento de contextos extensos y ofrece una velocidad y eficacia superiores a las de los modelos anteriores. - ¿Cómo gestiona Jamba 1.5 los contextos extensos?

Con una ventana de contexto de 256.000 tokens, Jamba 1.5 puede procesar grandes cantidades de texto manteniendo una alta precisión, lo que lo hace ideal para narraciones complejas y documentos extensos. - ¿Qué idiomas admite Jamba 1.5?

Jamba 1.5 es multilingüe y domina idiomas como el español, el francés y el alemán, entre otros, lo que le permite funcionar bien en diversos entornos lingüísticos. - ¿Qué es la cuantización ExpertsInt8 en Jamba 1.5?

ExpertsInt8 es una técnica de cuantificación que reduce las necesidades de recursos del modelo. Permite ejecutar Jamba 1.5 Large en sólo ocho GPU de 80 GB, lo que lo hace más rentable. - ¿Se puede implantar Jamba 1.5 in situ?

Sí, Jamba 1.5 admite implantaciones tanto en la nube como en las instalaciones, lo que proporciona flexibilidad en función de las necesidades y la infraestructura de la organización.